Künstliche Intelligenz

-

Prompte Langeweile: Forschende warnen vor Vereinheitlichung menschlicher Ausdrucksformen durch KI

Informatiker und Psychologen warnen, dass KI-Chatbots menschliche Ausdrucksformen und Denkweisen zunehmend vereinheitlichen könnten. Sprachmodelle glätten individuelle Stile und bevorzugen dominante Perspektiven. Um kognitive Vielfalt zu bewahren, sollten Entwickler mehr kulturelle und sprachliche Diversität in Trainingsdaten und Nutzung integrieren.

-

![[Buchtipp] Technologie ist kein Patentrezept: Carl Benedikt Frey führt vor, wie Fortschritt endet](https://phaenomenal.net/wp-content/uploads/2026/03/Buchtipp_Intro_Fortschritt_endet.jpg)

[Buchtipp] Technologie ist kein Patentrezept: Carl Benedikt Frey führt vor, wie Fortschritt endet

Der Wirtschaftshistoriker Carl Benedikt Frey zeigt in „Wie Fortschritt endet“, dass technologische Innovation keineswegs automatisch Wohlstand bringt. Anhand historischer Beispiele erklärt er, warum Phasen rasanten Fortschritts immer wieder von Stagnation oder Machtkonzentration abgelöst werden – und was das über die Gegenwart verrät.

-

Der digitale Kommilitone: KI-Tools verändern den Hochschulalltag

Künstliche Intelligenz hält rasch Einzug in Hörsäle und Bibliotheken. Eine Studie der Fachhochschule Erfurt zeigt: Rund neunzig Prozent der Studierenden und Lehrenden nutzen bereits KI-Tools. Gleichzeitig bleiben Skepsis, rechtliche Fragen und Qualitätsprobleme. Hochschulen müssen deshalb verstärkt entsprechende Kompetenzen vermitteln und Regeln für den verantwortlichen Einsatz entwickeln.

-

Sag mir wo du stehst: Wenn ChatGPT & Co. auf den Wahl-o-Mat treffen

Eine Studie der Hochschule München zeigt, dass große Sprachmodelle wie ChatGPT oder Grok bei politischen Fragen nicht vollständig neutral antworten. Ihre Positionen liegen häufig im Mitte-Links-Spektrum. Forschende fordern deshalb mehr Transparenz, kritische Nutzung und langfristig vielfältigere Trainingsdaten für KI-Systeme.

-

Kein Weltuntergang durch KI – Georgia-Tech-Studie rät zu Gelassenheit

Eine Studie der Georgia Tech kommt zu dem Schluss, dass eine allmächtige, autonome KI keine realistische existenzielle Bedrohung darstellt. Unklare Definitionen von Intelligenz, programmierbare Fehlanreize und physikalische Grenzen sprechen gegen apokalyptische Szenarien. Entscheidend seien kluge, sektorspezifische Regulierungen.

-

Die schwerste Prüfung der Welt: Wo Künstliche Intelligenz (noch) an ihre Grenzen stößt

Mit „Humanity’s Last Exam“ präsentieren Forschende einen neuen Maßstab für Künstliche Intelligenz. Die 2.500 Expertenfragen liegen bewusst über aktuellen KI-Fähigkeiten. Ziel ist eine präzisere Einschätzung von Fortschritt und Risiken – und eine Erinnerung daran, dass menschliche Expertise weiterhin unverzichtbar bleibt.

-

Wenn ChatGPT zur Zweitkorrektorin wird – KI besteht im Prüfungsalltag

Eine Studie der Universität Passau zeigt: ChatGPT kann bei Prüfungen ähnlich zuverlässig bewerten wie menschliche Prüferinnen und Prüfer. Ganz ersetzen kann und soll sie sie aber nicht. Die Forschenden sehen die KI eher als „kritische Zweitkorrektorin“, die entlasten, aber nicht die Verantwortung übernehmen kann.

-

Hör auf’s Herz: Wie KI lernt, menschliche Gefühle zu verstehen

Forscher aus Bochum und Zürich haben eine Schnittstelle entwickelt, über die Künstliche Intelligenz Herzfrequenzdaten in Echtzeit verstehen kann. Das System reagiert auf physiologische Signale wie Stress oder Überforderung – und eröffnet neue Perspektiven für Medizin, Pflege und adaptive Lernumgebungen.

-

![[Buchtipp] Wie Naturschutz und Biodiversität von KI profitieren können](https://phaenomenal.net/wp-content/uploads/2025/10/Buchtipp_Kann_KI_Welt_retten_intro.jpg)

[Buchtipp] Wie Naturschutz und Biodiversität von KI profitieren können

Frauke Fischer und Hilke Oberhansberg zeigen in „Kann KI die Natur retten?“, dass Technologie und Biodiversität kein Widerspruch sein müssen. Ihr Buch diskutiert unterhaltsam und faktenreich Chancen und Risiken digitaler Helfer bei Themen wie Biodiversität oder Artenschutz.

-

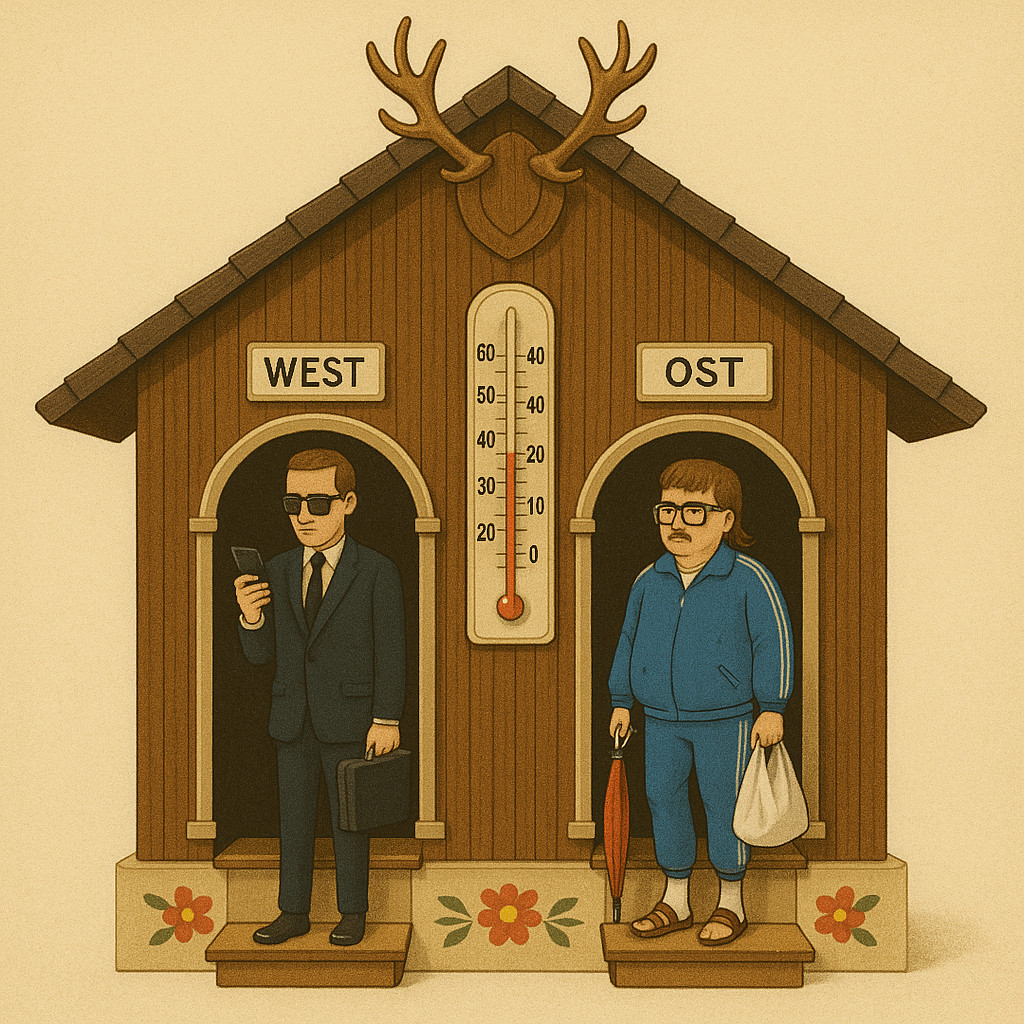

ChatGPT hat Vorurteile gegenüber Ostdeutschen

Eine Studie der Hochschule München zeigt, dass KI-Sprachmodelle wie ChatGPT Vorurteile gegenüber Ostdeutschen reproduzieren. Selbst neutrale Eigenschaften werden systematisch niedriger bewertet. Forschende warnen vor struktureller Benachteiligung, etwa in Bewerbungsverfahren, und fordern gezieltere Strategien gegen algorithmische Diskriminierung.