Künstliche Intelligenz

-

Die schwerste Prüfung der Welt: Wo Künstliche Intelligenz (noch) an ihre Grenzen stößt

Mit „Humanity’s Last Exam“ präsentieren Forschende einen neuen Maßstab für Künstliche Intelligenz. Die 2.500 Expertenfragen liegen bewusst über aktuellen KI-Fähigkeiten. Ziel ist eine präzisere Einschätzung von Fortschritt und Risiken – und eine Erinnerung daran, dass menschliche Expertise weiterhin unverzichtbar bleibt.

-

Herzklappenfehler: KI-Stethoskop entdeckt deutlich mehr Fälle als ein Allgemeinmediziner

Eine Cambridge-Studie zeigt: Ein KI-gestütztes digitales Stethoskop erkennt schwere Herzklappenerkrankungen zuverlässiger als Hausärzte. Die Technologie identifizierte 98 Prozent schwerer Aortenstenosen. Sie könnte als schnelles Screening dienen, Wartezeiten auf Echokardiografie verkürzen und Leben retten – bevor Symptome auftreten.

-

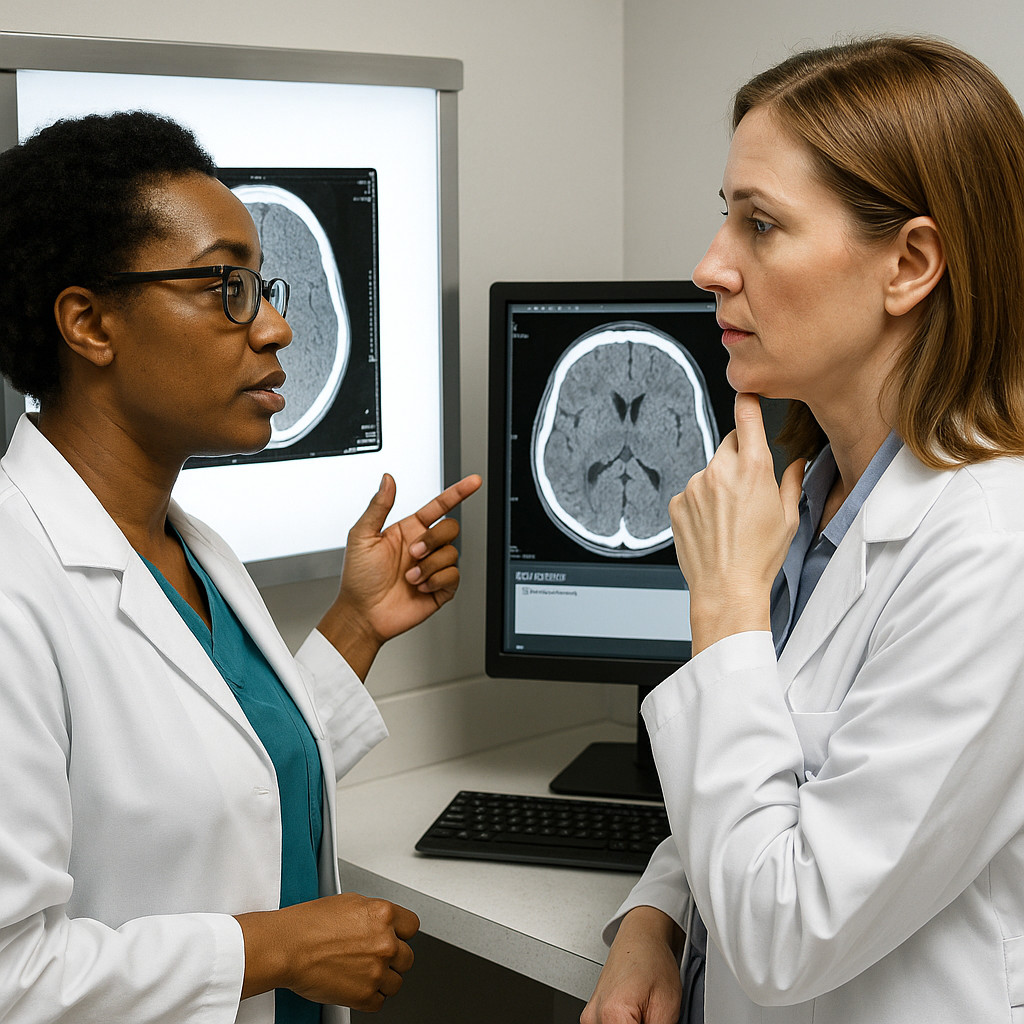

Zielgerichtet oder gewohnheitsmäßig? Neue Theorie erklärt, wie das Hirn unser Verhalten lenkt

Ein internationales Forschungsteam hat ein neues Modell der Handlungssteuerung im Gehirn vorgestellt. Statt zwischen „zielgerichtet“ und „gewohnheitsmäßig“ zu unterscheiden, zeigen die Forschenden, dass unser Verhalten auf einem Kontinuum beruht – geprägt durch interagierende Schaltkreise. Ihre Erkenntnisse könnten auch KI-Systeme effizienter machen.

-

Wenn ChatGPT zur Zweitkorrektorin wird – KI besteht im Prüfungsalltag

Eine Studie der Universität Passau zeigt: ChatGPT kann bei Prüfungen ähnlich zuverlässig bewerten wie menschliche Prüferinnen und Prüfer. Ganz ersetzen kann und soll sie sie aber nicht. Die Forschenden sehen die KI eher als „kritische Zweitkorrektorin“, die entlasten, aber nicht die Verantwortung übernehmen kann.

-

KI-Bildgeneratoren verstärken Geschlechterstereotype je nach Sprache unterschiedlich stark

Eine neue Studie von TUM und TU Darmstadt zeigt: KI-Bildgeneratoren verstärken Geschlechterstereotype – und zwar je nach Sprache unterschiedlich stark. Der gleiche Berufsprompt führt in verschiedenen Sprachen zu völlig unterschiedlichen Darstellungen. Sprachsensibilität wird damit zum Schlüssel für faire KI.

-

Im Team Mensch-KI ist der Mensch oft das größere Risiko

Menschen und KI als Team sind kein Selbstläufer: Laut TU Berlin übersteuern Fachkräfte oft korrekte Systeme, unterschätzen die Zuverlässigkeit und folgen Vorurteilen. Wirksame Aufsicht braucht verhaltensleitende Erklärungen, klare Eingriffsregeln und Messbarkeit von Ergebnissen. Ziel ist eine Synergie, bei der jede Seite ihre Stärken einbringt.

-

Hör auf’s Herz: Wie KI lernt, menschliche Gefühle zu verstehen

Forscher aus Bochum und Zürich haben eine Schnittstelle entwickelt, über die Künstliche Intelligenz Herzfrequenzdaten in Echtzeit verstehen kann. Das System reagiert auf physiologische Signale wie Stress oder Überforderung – und eröffnet neue Perspektiven für Medizin, Pflege und adaptive Lernumgebungen.

-

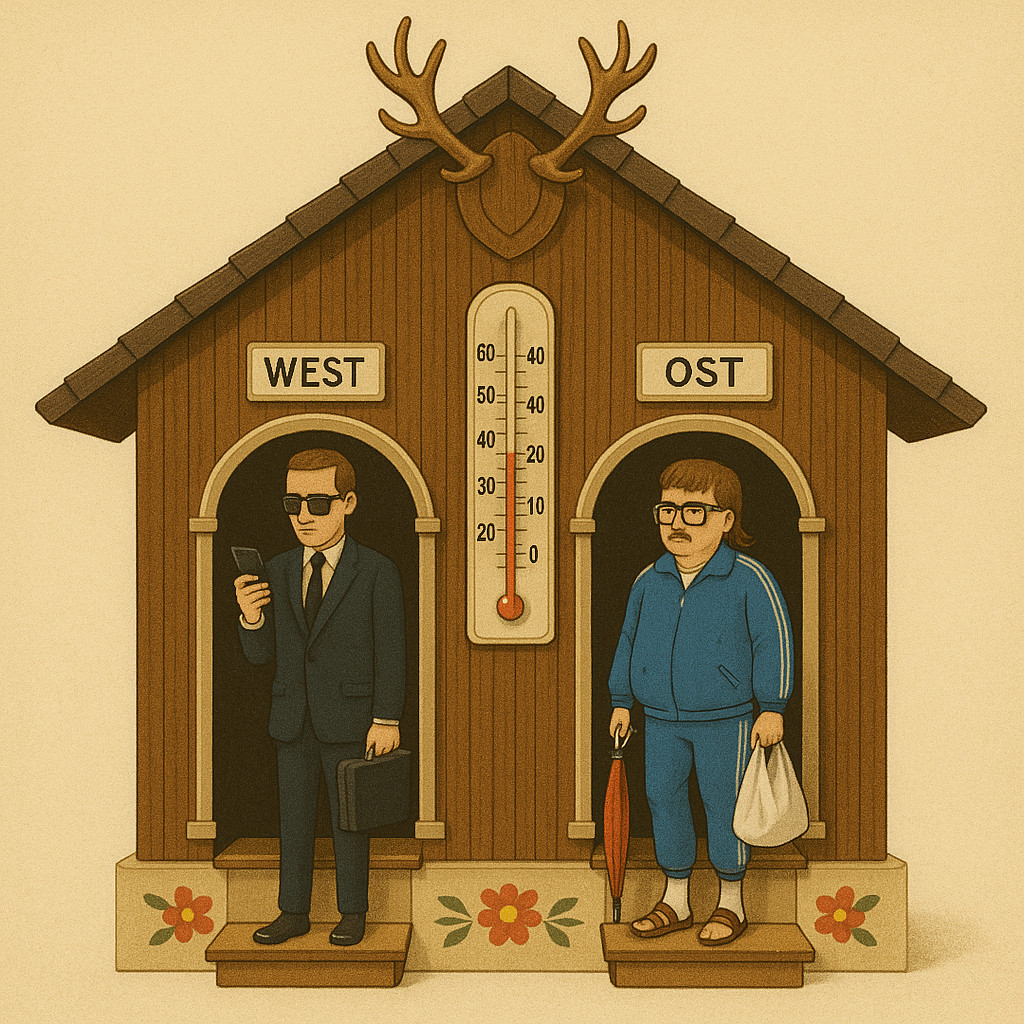

ChatGPT hat Vorurteile gegenüber Ostdeutschen

Eine Studie der Hochschule München zeigt, dass KI-Sprachmodelle wie ChatGPT Vorurteile gegenüber Ostdeutschen reproduzieren. Selbst neutrale Eigenschaften werden systematisch niedriger bewertet. Forschende warnen vor struktureller Benachteiligung, etwa in Bewerbungsverfahren, und fordern gezieltere Strategien gegen algorithmische Diskriminierung.

-

ChatGPT-ähnliche KI kartiert das Mäusehirn so exakt wie nie zuvor

Ein Forschungsteam der University of California, San Francisco, und des Allen Institute hat mit einem ChatGPT-ähnlichen KI-Modell eine der bislang detailliertesten Gehirnkarten einer Maus erstellt. Das System „CellTransformer“ identifiziert automatisch über 1.300 Regionen und enthüllt bislang unbekannte Subregionen des Gehirns.

-

Automatisch benachteiligt? Warum sozial Bedürftige oft KI misstrauen

Eine internationale Studie zeigt: Sozialleistungsbeziehende sind besonders skeptisch gegenüber KI-gestützten Entscheidungen in der Verwaltung. Während viele Bürger Geschwindigkeit schätzen, fürchten Betroffene Fehlurteile und Machtlosigkeit. Forschende fordern partizipative Entwicklungsprozesse, um Vertrauen aufzubauen und das Risiko automatischer Benachteiligung zu verringern.