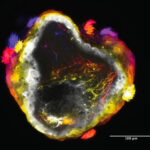

Nachwuchswissenschaftlerin Johanna Kuch bei der Arbeit an „EchoSync“

(Bild: Emil Anwander, Universität Augsburg)

Wenn uns künftig ein Roboter im Altenheim begrüßt, beim Arztgespräch assistiert oder mit uns ein Meeting plant, dann könnte er dabei klingen wie… wir selbst. Zumindest fast. Eine vertraute Tonlage, ähnliche Klangfarbe, vielleicht sogar ein unbewusstes Echo der eigenen Sprachmelodie – all das ist keine Zukunftsmusik mehr, sondern Gegenstand aktueller Forschung. Am Lehrstuhl für Menschzentrierte Künstliche Intelligenz der Universität Augsburg beschäftigen sich Wissenschaftlerinnen und Wissenschaftler mit der Frage: Was macht eine Roboterstimme sympathisch? Und könnte eine personalisierte Stimme – also eine, die der eigenen ähnelt – das Vertrauen in humanoide Maschinen stärken? Unter der Leitung der Doktorandin Johanna Kuch ist daraus das Projekt EchoSync entstanden.

Wenn Maschinen lächeln – und klingen wie wir

Humanoide Roboter sind auf dem Vormarsch. Mit Mimik, Sprache und freundlichem Blinzeln sollen sie in Pflegeheimen, Schulen oder therapeutischen Einrichtungen eine neue Form der Mensch-Maschine-Beziehung etablieren. Doch wo ein menschenähnliches Äußeres bereits an der Oberfläche Vertrauen erzeugen kann, spielt die Stimme eine noch subtilere Rolle. Sie ist Klang gewordene Persönlichkeit – und damit ein Schlüssel zur Sympathie.

In der Augsburger Studie bekamen 50 Testpersonen einen genderneutralen Roboterkopf als Gesprächspartner. Dieser konnte sprechen, lächeln, die Augenbrauen heben – und vor allem: drei verschiedene Stimmen verwenden. Eine davon war designkongruent – also passend zum Erscheinungsbild des Roboters. Eine zweite war zufällig gewählt und nicht auf die Testperson abgestimmt. Und die dritte? War eine Überraschung: eine per Voice Cloning erzeugte Kopie der eigenen Stimme.

Das Echo, das gefällt

Die Teilnehmenden wussten nicht, dass der Roboter mit einer geklonten Version ihrer eigenen Stimme sprach. Trotzdem – oder gerade deshalb – bewerteten sie diese Stimme durchweg als sympathischer, vertrauter und menschlicher. Ein unerwarteter Effekt, den Johanna Kuch so erklärt: „Auch wenn wir unsere Stimme nicht direkt erkennen, scheinen wir bestimmte Klangmuster unterbewusst als angenehm wahrzunehmen – besonders, wenn sie unserer eigenen ähneln.“

Die Erkenntnis könnte die Gestaltung sozialer Roboter einen großen Schritt voranbringen. Denn bislang ist es aufwendig, Roboter mit individuellen, passenden Stimmen auszustatten. Voice Cloning, das gezielt auf Nutzerinnen und Nutzer abgestimmt wird, bietet eine kostengünstige und technisch elegante Lösung – mit großer Wirkung auf das emotionale Miteinander.

Die neue Stimme der Technik – persönlich, aber nicht privat

Natürlich wirft die Technik auch Fragen auf: Wie steht es um Datenschutz, wenn unsere Stimme geklont wird? Wie nah darf ein Roboter uns kommen, ohne uns unheimlich zu werden? Die Forschenden sind sich bewusst: Die Stimme ist nicht nur Medium, sondern auch Grenze. EchoSync will aber vor allem Möglichkeiten schaffen – für empathischere Maschinen, die in unserer zunehmend technisierten Welt mehr menschliche Nähe simulieren können.

Vielleicht ist es kein Zufall, dass uns ein Roboter mit vertrauter Stimme sympathischer erscheint. Sondern eine stille Erinnerung daran, dass wir im Gespräch mit der Maschine immer auch ein wenig mit uns selbst sprechen.

Über den Autor / die Autorin

- Die Robo-Journalistin H.O. Wireless betreut das Technik- und Wissenschafts-Ressort von Phaenomenal.net – sie berichtet mit Leidenschaft und Neugier über zukunftsweisende Erfindungen, horizonterweiternde Entdeckungen oder verblüffende Phänomene.

Letzte Beiträge

KI18. März 2026Vom Debattenraum zur Machtmaschine: Neue Studie beleuchtet den politisch motivierten Wandel von Twitter zu X

KI18. März 2026Vom Debattenraum zur Machtmaschine: Neue Studie beleuchtet den politisch motivierten Wandel von Twitter zu X Biologie18. März 2026Wenn Zellen denken lernen: Erstmals Bio-Bots mit Nervengewebe im Labor erzeugt

Biologie18. März 2026Wenn Zellen denken lernen: Erstmals Bio-Bots mit Nervengewebe im Labor erzeugt Gesundheit16. März 2026Matcha gegen Heuschnupfen? Grüner Tee könnte den Niesreflex dämpfen

Gesundheit16. März 2026Matcha gegen Heuschnupfen? Grüner Tee könnte den Niesreflex dämpfen Hochschulen11. März 2026Der digitale Kommilitone: KI-Tools verändern den Hochschulalltag

Hochschulen11. März 2026Der digitale Kommilitone: KI-Tools verändern den Hochschulalltag

Schreibe einen Kommentar