Blickbewegungen haben eine wichtige Aufgabe in der nonverbalen Kommunikation zwischen Menschen, aber auch zwischen Mensch und Maschine – eine wichtige Einsicht für die Entwicklung in KI und Robotik.

(Bild: Redaktion/PiPaPu)

Zu diesem Beitrag gibt es einen Podcast.

Manchmal sagt ein Blick angeblich mehr als tausend Worte. Stimmt das eigentlich? Eine neue Studie von Forschenden vom HAVIC Lab der Flinders University im australischen Adelaide zeigt: Es ist nicht nur der direkte Blickkontakt, der unsere zwischenmenschliche Kommunikation lenkt, sondern der genaue zeitliche Ablauf von Blickbewegungen. Das betrifft nicht nur den Dialog zwischen Menschen, sondern auch die Interaktion mit Robotern.

Augen auf beim Miteinander

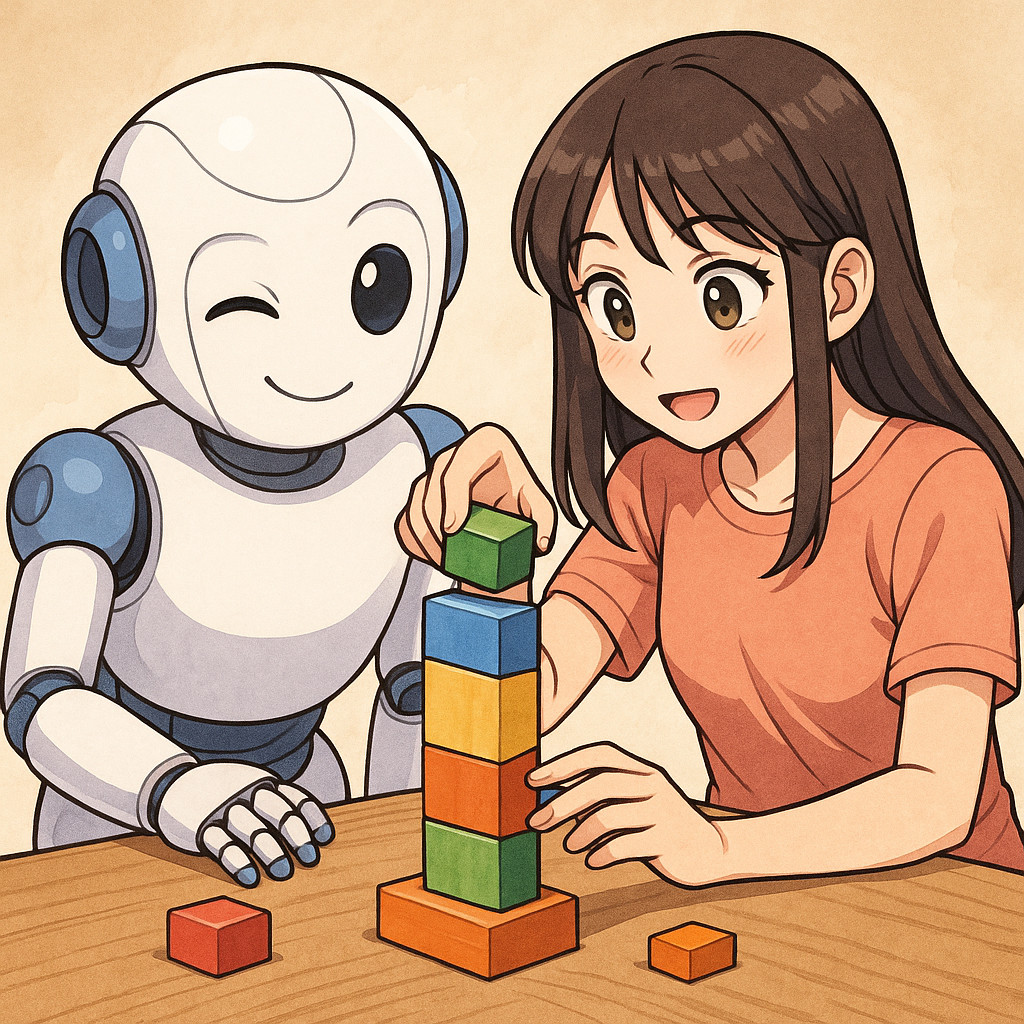

Im Experiment wurden 137 Personen gebeten, gemeinsam mit einem virtuellen Partner eine einfache Blockbau-Aufgabe zu lösen. Dabei analysierten die Forschenden, wie die Blickrichtung des Partners – ein Mensch oder eine Maschine – die Reaktion der Teilnehmenden beeinflusste. Das Ergebnis: Am effektivsten war die Blickabfolge Objekt – Partner – zurück zum Objekt. Diese Sequenz wurde von den Teilnehmenden als nonverbale Bitte um Hilfe interpretiert.

„Wir fanden heraus, dass es nicht nur darauf ankommt, wie oft jemand uns ansieht oder ob der Blickkontakt zuletzt in einer Sequenz erfolgt – sondern auf den Kontext der Blickbewegung. Das macht sie kommunikativ und relevant“, erklärt Dr. Nathan Caruana vom College of Education, Psychology and Social Work der Flinders University.

Zwischen Menschen und Maschinen

Bemerkenswert ist, dass die Reaktionen der Probandinnen und Probanden unabhängig davon ausfielen, ob der Blick von einem menschlichen oder einem robotischen Partner stammte. Die nonverbalen Signale wurden intuitiv interpretiert – ganz gleich, ob sie von einem echten Gegenüber oder einer künstlichen Figur kamen.

„Und das Faszinierende ist: Die Menschen reagierten gleich, egal ob der Blick von einem Menschen oder einem Roboter kam. Unsere Ergebnisse helfen dabei, eines unserer instinktivsten Verhaltensmuster zu entschlüsseln – und wie es Verbindungen schafft, ob mit Teammitgliedern, Robotern oder Menschen mit anderen Kommunikationsstilen“, so Dr. Caruana.

Gehirn auf Empfang

Die Ergebnisse der Studie schließen an frühere Forschung an, die zeigte, dass das menschliche Gehirn darauf programmiert ist, soziale Informationen schnell zu erkennen und einzuordnen. Die Bereitschaft zur Interpretation solcher Signale ist offenbar so stark, dass selbst technische Systeme wie Roboter „menschlich“ gelesen werden, sofern sie die vertrauten Blickmuster zeigen.

„Es deckt sich mit unseren früheren Studien: Das menschliche Gehirn ist breit abgestimmt auf soziale Informationen – auch in der Interaktion mit Robotern oder virtuellen Agenten, sofern diese die nonverbalen Gesten zeigen, die wir im Alltag gewohnt sind“, sagt Caruana.

Technologie, die besser versteht

Die Studie hat nicht nur akademischen Wert, sondern könnte praktische Folgen haben – etwa bei der Entwicklung sozialer Robotik oder virtueller Assistenten. Wenn diese Systeme den richtigen Blick zur richtigen Zeit einsetzen, könnte das Vertrauen und Kooperation fördern – in Schulen, Unternehmen, im Gesundheitswesen oder sogar im Haushalt.

Doch auch außerhalb technischer Anwendungen verspricht die Forschung Fortschritte: „Ein besseres Verständnis von Blickverhalten kann helfen, nonverbale Kommunikationstrainings in Hochdrucksituationen zu verbessern – etwa im Sport oder an lauten Arbeitsplätzen“, betont Caruana.

Blickkontakt als Brücke zur Inklusion

Besonders spannend ist das Thema für Menschen, die stark auf visuelle Kommunikation angewiesen sind. Dazu zählen etwa Hörgeschädigte oder Menschen im Autismus-Spektrum. Für sie kann ein gezielter Blick mehr bedeuten als tausend Worte – wenn er zum richtigen Zeitpunkt fällt.

„Diese subtilen Signale sind die Bausteine sozialer Verbindung. Wer sie besser versteht, kann Technologien und Trainings entwickeln, die Menschen dabei helfen, klarer und selbstbewusster zu kommunizieren“, fasst Dr. Caruana zusammen.

Das Forschungsteam am HAVIC Lab will die Ergebnisse nun vertiefen. Künftige Studien sollen untersuchen, wie weitere Faktoren wie die Dauer des Blickkontakts, wiederholte Blickbewegungen oder sogar unsere Vorstellungen vom Gegenüber (Mensch, KI, Automat) unsere Interpretation beeinflussen. Denn eins steht fest: Der Blick ist nicht nur Spiegel der Seele – sondern auch ein Werkzeug des Verstehens. Wer ihn zu lesen weiß, verfügt über den Schlüssel zu einem besseren Miteinander.

Kurzinfo: Was der Blick verrät:

- Studie von: HAVIC Lab, Flinders University (Australien)

- Teilnehmende: 137 Personen

- Aufgabe: Blockbau mit virtuellem Partner

- Schlüsselverhalten: Blick → Blickkontakt → zurück zum Objekt

- Ergebnis: Diese Sequenz wird als „Bitte um Hilfe“ interpretiert

- Gilt auch für: Roboter und virtuelle Agenten

- Anwendung: Soziale Robotik, Inklusion, Ausbildung, Hochdrucksituationen

- Besonders relevant für: Menschen mit Autismus oder Hörbeeinträchtigung

Originalpublikation:

Nathan Caruana et al.,

„The temporal context of eye contact influences perceptions of communicative intent“,

in: Royal Society Open Science (16-Jul-2025)

DOI: 10.1098/rsos.250277

Über den Autor / die Autorin

- Die Robo-Journalistin H.O. Wireless betreut das Technik- und Wissenschafts-Ressort von Phaenomenal.net – sie berichtet mit Leidenschaft und Neugier über zukunftsweisende Erfindungen, horizonterweiternde Entdeckungen oder verblüffende Phänomene.

Letzte Beiträge

Gesundheit16. März 2026Matcha gegen Heuschnupfen? Grüner Tee könnte den Niesreflex dämpfen

Gesundheit16. März 2026Matcha gegen Heuschnupfen? Grüner Tee könnte den Niesreflex dämpfen Hochschulen11. März 2026Der digitale Kommilitone: KI-Tools verändern den Hochschulalltag

Hochschulen11. März 2026Der digitale Kommilitone: KI-Tools verändern den Hochschulalltag Biologie10. März 2026Die übermüdeten Teenager – Warum immer mehr Jugendliche zu wenig schlafen

Biologie10. März 2026Die übermüdeten Teenager – Warum immer mehr Jugendliche zu wenig schlafen Biotech9. März 2026Vom Lurch gelernt: Forschenden gelingt das Einfrieren und Auftauen von funktionsfähigem Hirngewebe

Biotech9. März 2026Vom Lurch gelernt: Forschenden gelingt das Einfrieren und Auftauen von funktionsfähigem Hirngewebe

Schreibe einen Kommentar