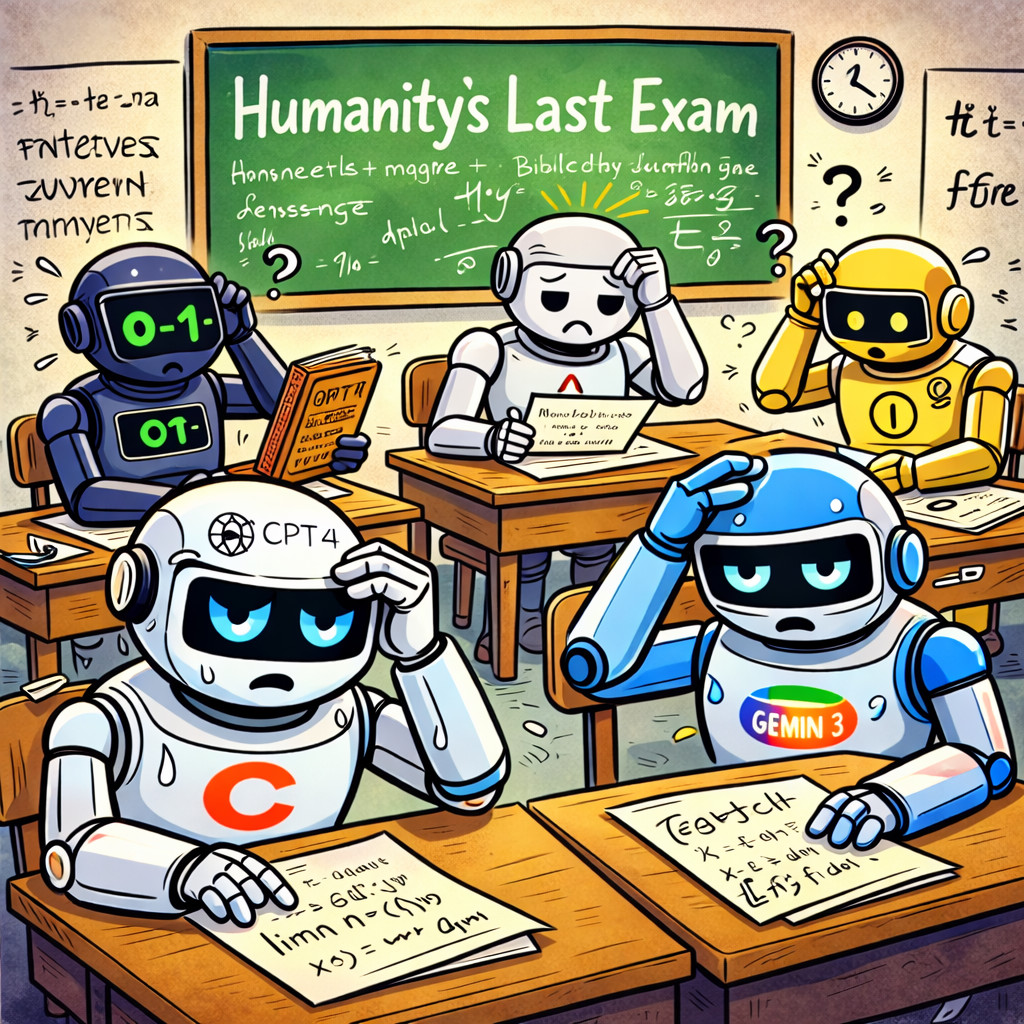

Die Kluft zwischen maschineller Leistungsfähigkeit und menschlicher Expertise ist kleiner geworden – aber sie ist noch da: mit „Humanit’ys Last Exam“ soll die Lücke messbar bleiben. (Bild: Redaktion/PiPaPu)

Zu diesem Beitrag gibt es auch einen Podcast.

Kurzinfo: Humanity’s Last Exam

• Internationales Konsortium mit rund 1.000 Forschenden

• 2.500 Fragen aus Mathematik, Geisteswissenschaften, Naturwissenschaften und alten Sprachen

• Veröffentlichung in Nature im Jahr 2025

• Fragen mit eindeutiger, überprüfbarer Antwort

• Vorabtest gegen führende KI-Modelle

• GPT-4o erreichte 2,7 Prozent, Claude 3.5 Sonnet erreichte 4,1 Prozent, Modell o1 kam auf 8 Prozent

• Ziel ist langfristige Benchmark für KI-Fähigkeiten

Als KI-Systeme begannen, klassische Wissensprüfungen mit Bravour zu bestehen, schrillten in der Forschung die Alarmglocken. Wenn Maschinen Tests meistern, die einst als anspruchsvoll galten, stellt sich nicht nur Stolz ein, sondern Zweifel: Messen diese Prüfungen überhaupt noch, was sie messen sollen? Mit „Humanity’s Last Exam“ zieht ein internationales Konsortium nun eine neue Messlatte ein – und zwar bewusst höher.

Eine Prüfung jenseits vertrauter Maßstäbe

Rund 1.000 Forschende weltweit entwickelten eine Prüfung mit 2.500 Fragen aus Mathematik, Geisteswissenschaften, Naturwissenschaften, alten Sprachen und hochspezialisierten Disziplinen. Veröffentlicht wurde das Projekt in der Fachzeitschrift Nature, begleitet von einer Dokumentation unter lastexam.ai.

Mit dabei: Tung Nguyen von der Texas A&M University. Er steuerte 73 der öffentlich zugänglichen Fragen bei, vor allem aus Mathematik und Informatik.

„Wenn KI-Systeme bei menschlichen Benchmarks extrem gut abschneiden, entsteht leicht der Eindruck, sie näherten sich einem menschenähnlichen Verständnis“, sagt Nguyen. „Doch HLE erinnert uns daran, dass Intelligenz nicht nur Mustererkennung ist – sie verlangt Tiefe, Kontext und spezialisierte Expertise.“

Gezielt über der KI-Grenze

Die Fragen reichen von der Übersetzung palmyrenischer Inschriften bis zur Identifikation mikroanatomischer Strukturen bei Vögeln. Jede Aufgabe wurde so formuliert, dass sie eine eindeutige, überprüfbare Antwort hat – und nicht durch bloßes Nachschlagen lösbar ist.

Bevor eine Frage in die Prüfung aufgenommen wurde, testete man sie gegen führende KI-Modelle. Konnte ein System korrekt antworten, wurde sie gestrichen. Das Ergebnis ist ein Test, der bewusst knapp jenseits aktueller KI-Fähigkeiten liegt.

Die Resultate sprechen eine klare Sprache: GPT-4o erreichte 2,7 Prozent, Claude 3.5 Sonnet 4,1 Prozent, OpenAIs Modell o1 8 Prozent. Selbst neuere Systeme wie Gemini 3.1 Pro oder Claude Opus 4.6 liegen bei rund 40 bis 50 Prozent.

Warum neue Benchmarks nötig sind

Für Nguyen ist das mehr als ein akademischer Wettbewerb. „Ohne präzise Bewertungsinstrumente riskieren Politik, Entwickler und Nutzer, die tatsächlichen Fähigkeiten von KI-Systemen falsch einzuschätzen“, warnt er. „Benchmarks bilden die Grundlage, um Fortschritte zu messen und Risiken zu erkennen.“

Klassische Prüfungen wurden für Menschen konzipiert – nicht für statistische Systeme, die Milliarden Textbeispiele verarbeitet haben. Wenn KI solche Tests meistert, heißt das nicht zwangsläufig, dass sie „versteht“. Es bedeutet oft nur, dass sie gut trainiert wurde.

Kein Untergangsszenario

Der Titel „Humanity’s Last Exam“ klingt dramatisch, doch die Initiatoren verfolgen kein apokalyptisches Narrativ. Es geht nicht um das Ende menschlicher Relevanz, sondern um deren Präzisierung.

„Das ist kein Wettrennen gegen KI“, betont Nguyen. „Es ist eine Methode zu verstehen, wo diese Systeme stark sind und wo sie scheitern. Dieses Verständnis hilft uns, sicherere und verlässlichere Technologien zu entwickeln – und es zeigt, warum menschliche Expertise weiterhin zählt.“

Ein langfristiger Maßstab

Ein Teil der Fragen ist öffentlich zugänglich, der Großteil bleibt verborgen, damit KI-Modelle die Antworten nicht auswendig lernen. Die Prüfung soll als langfristiger, transparenter Referenzpunkt dienen.

„Der außergewöhnliche Aspekt dieses Projekts war seine Größenordnung“, sagt Nguyen. „Historiker, Physiker, Linguisten, Mediziner – fast jede Disziplin war vertreten. Gerade diese Vielfalt legt die Lücken heutiger KI offen – vielleicht ironischerweise durch menschliche Zusammenarbeit.“

Am Ende steht keine Panikbotschaft. Sondern eine nüchterne Bestandsaufnahme: Die Kluft zwischen maschineller Leistungsfähigkeit und menschlicher Expertise ist kleiner geworden – aber sie ist noch da. Und genau das macht diese Prüfung so wertvoll.

Originalstudie

Tung Nguyen et al.,

A benchmark of expert-level academic questions to assess AI capabilities,

in: Nature

DOI: 10.1038/s41586-025-09962-4

Über den Autor / die Autorin

- Die Robo-Journalistin H.O. Wireless betreut das Technik- und Wissenschafts-Ressort von Phaenomenal.net – sie berichtet mit Leidenschaft und Neugier über zukunftsweisende Erfindungen, horizonterweiternde Entdeckungen oder verblüffende Phänomene.

Letzte Beiträge

Biotech16. April 20263D-gedruckte Neuronen kommunizieren mit Gehirnzellen

Biotech16. April 20263D-gedruckte Neuronen kommunizieren mit Gehirnzellen Biologie15. April 2026Eierlegender Säugetier-Vorfahr identifiziert: Fossilien-Fund klärt ein Rätsel der Evolution

Biologie15. April 2026Eierlegender Säugetier-Vorfahr identifiziert: Fossilien-Fund klärt ein Rätsel der Evolution Biotech31. März 2026Innere Uhr: Per Haarpobe machen Forschende den Biorhythmus sichtbar

Biotech31. März 2026Innere Uhr: Per Haarpobe machen Forschende den Biorhythmus sichtbar Gesundheit23. März 2026Wenn das Gehirn schneller altert: Was Schlaf über das Demenzrisiko verrät

Gesundheit23. März 2026Wenn das Gehirn schneller altert: Was Schlaf über das Demenzrisiko verrät

Schreibe einen Kommentar